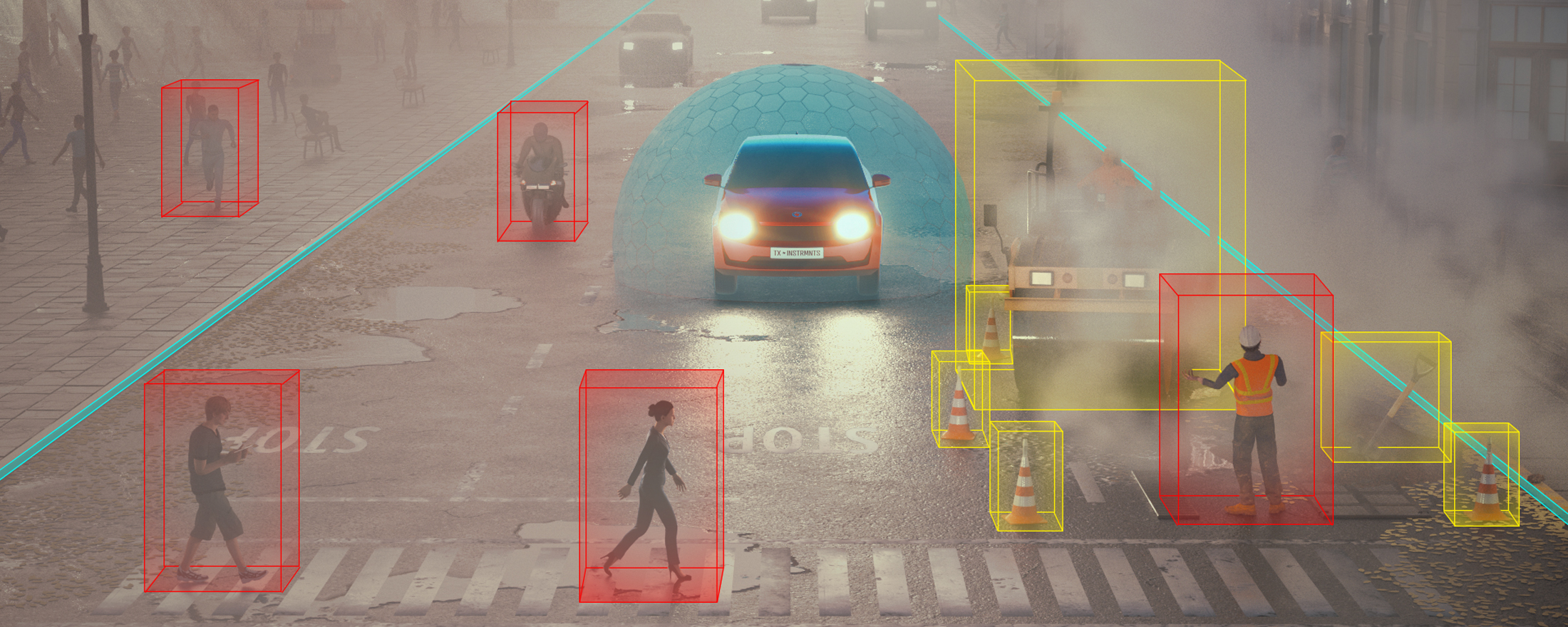

Eine wachsende Anzahl von zeitkritischen Anwendungen wie Notfallbremsung, Kamera-, Ultraschall- und Lidar-Sensoranwendungen für Kollisionswarnsysteme und Totwinkelerkennung in modernen Fahrzeugen benötigen den Einsatz hoch entwickelter Fahrerassistenzsysteme (ADAS), die Daten aus mehreren Sensoren zusammenführen und verlässliche Entscheidungen in Echtzeit für mehr Sicherheit im autonomen Fahren ermöglichen

Es gibt bereits Kameras mit KI-Funktionalität, die unsere Fahrzeuge intelligenter und sicherer machen und z. B. dem Lesen von Straßenschildern und der Fahrstreifenbegrenzung dienen. Diese Systeme sind an und für sich sehr gut, aber was ist, wenn plötzlich Nebel aufzieht und die Kamera genauso wenig sehen kann wie Sie selbst?

„Kameras sind wirklich toll wenn es um Objekterkennung geht, aber nachts oder bei schlechtem Wetter taugen sie nicht so viel,” erklärte Miro Adzan, General Manager unserer Abteilung für fortgeschrittene Fahrerassistenzsysteme (ADAS). „Radar, jedoch, funktioniert auch bei Regen, Schnee oder Nebel. Fahrerassistenzsysteme müssen eine Vielzahl von verschiedenen Sensoren integrieren, sodass Fahrzeuge voll von den Vorteilen der verschiedenen Technologien profitieren können.”

Um die Vorteile der verschiedenen Arten von Sensoren optimal zu nutzen, bedarf es mehr als nur der Möglichkeit, zwischen ihnen für verschiedene Bedingungen oder Anwendungen hin- und herschalten zu können. Bei guten Sichtverhältnissen sind Kameras besser für die Erkennung von Details geeignet, aber mit Radar kann die Entfernung zu einem Objekt genauer bestimmt werden.

Erfahren Sie, wie unsere Produkte mehr Sicherheit beim autonomen Fahren ermöglichen.

Diese Systeme werden immer häufiger in zeitkritischen Anwendungen wie Notfallbremsung, automatische Einparkhilfen, Kamera-, Ultraschall- und Lidar-Sensoranwendungen für Kollisionswarnsysteme und Totwinkelerkennung eingesetzt. Um ein vollständiges Lagebild für verlässliche Entscheidungsfindung in Echtzeit zu ermöglichen ist es zu einer der Hauptaufgaben für Entwicklungsingenieure geworden die große Anzahl unterschiedlicher Informationsquellen zusammenführen.

„Für die automatische Einparkhilfe müssen Daten aus Kameras, Radar und manchmal Ultraschall zusammengeführt werden, um dem Fahrzeug ein korrektes Bild von seiner Umgebung zu bieten,” sagte Curt Moore, General Manager in unserer Abteilung für Jacinto™-Prozessoren. „Keiner dieser Sensoren alleine würde ausreichen, aber durch die Kombination vieler verschiedener Sensoren, kann ein viel genaueres Bild von der Umgebung um Sie herum angefertigt werden. So können Sie in viel engere Parklücken einparken, ohne dass Sie dabei riskieren müssen, Ihr Fahrzeug zu beschädigen.”

Die Verbreitung von Sensoren in Fahrzeuganwendungen

In der Automobilindustrie gibt es Systeme mit fortschrittlichen Sicherheitsfunktionen schon längst nicht mehr nur für Fahrzeuge der Oberklasse. Fast 93 % der Fahrzeuge, die in den USA hergestellt werden, besitzen mindestens eine ADAS-Funktion. Bremsassistenten zum Beispiel sind schon heute üblich und werden bis September in 99 % aller in den USA hergestellten Neuwagen zur Standardausrüstung gehören.1

Dieser Wandel lässt sich auf die sinkenden Kosten für Sensoren und darauf zurückführen, dass Sensoren immer kleiner werden. MmWave Radarsensoren von TI integrieren ein vollständiges Radarsystem auf einem Chip, der die Größe einer Münze hat.

„Vor zehn Jahren wurde Radar, aufgrund seiner Größe, der erheblichen Kosten und Komplexität vornehmlich für Militäranwendungen verwendet,” erklärte Miro. „Aber schon bald wird Radar zur Standardausstattung in jedem Auto gehören.”

Die Ausbreitung erschwinglicher Sensoren schafft Möglichkeiten für neuartige Anwendungen, aber damit gehen auch neue Herausforderungen für ADAS-Ingenieure einher, denn sie müssen Systeme entwickeln, die Datenströme aus allen Sensoren zusammenführen und diese effizient verarbeiten können. Dabei müssen Sie auch noch strenge Anforderungen hinsichtlich der Kosten und des Stromverbrauch erfüllen.

Eine Frage der Kommunikation

In einem ADAS-System mit einem einzelnen Sensor findet die Vorverarbeitung für Objekterkennung nahe am Sensor statt, um die dort gewonnenen Informationen sofort nutzbar zu machen. Aber für die Sensordatenfusion werden rohe hochauflösende Daten, die sofort an eine zentrale Verarbeitungseinheit übermittelt werden können, benötigt, damit ein einheitliches genaues Umgebungsmodell erstellt werden kann, das vom Fahrzeug zur Vermeidung von Zusammenstößen genutzt werden kann.

„Da so viele Daten von den Sensorknoten übertragen werden, besteht die Herausforderung darin, alles zu synchronisieren, damit das Fahrzeug verstehen kann, was sich in der Umgebung abspielt und kritische Entscheidungen treffen kann,” sagt Heather Babcock, General Manager in unserer Abteilung für FPD-Link™-Produkte. „Um synchronisierte Daten in Echtzeit übertragen zu können, ist es wichtig, große Bandbreite mit der Fähigkeit, unkomprimierte Daten zu übertragen, zur Verfügung zu haben, denn durch das Komprimieren von Daten schleichen sich Verzögerungen bei der Übertragung ein.”

Unser FPD-Link-Kommunikationsprotokoll, das ursprünglich für die Übertragung digitaler Videos von Grafikprozessoren auf digitale Displays entwickelt wurde, eignet sich besonders gut für die Übertragung großer Mengen unkomprimierter Daten über mehrere Meter und mit einfachen, leicht verlegbaren Kabeln.

„Auf der einen Seite haben wir ein Standardprotokoll und einen FPD-Link-Serializer, der den Datenstrom mit einer externen sicheren und robusten proprietären Verschlüsselung umwandelt”, erklärte Heather. „Dies wird am anderen Ende einem paired Deserializer zugeordnet, der die Daten in ihr ursprüngliches Format zurückbringt und sie über verschiedene andere Schnittstellenprotokolle überträgt, die vom Produktportfolio von TI unterstützt werden.”

Ermöglicht effizientere Entscheidungsfindung

Sind diese Daten erst einmal an der zentralen Verarbeitungseinheit angekommen, müssen sie in ein vereinheitlichtes Modell, das die Umgebung des Autos darstellt, integriert werden. Dafür werden normalerweise arbeitsintensive Signalverarbeitungsprozesse und Deep-Learning-Algorithmen verwendet, die einen Anstieg des Stromverbrauchs und der Wärmeabgabe zur Folge haben.

Physische Begrenzungen, wie sie in einem Fahrzeug herrschen, erlegen den Batterie- und Kühlsystemen enge Raum- und Gewichtsbeschränkungen auf. Ingenieure, die an der Entwicklung von ADAS-Systemen arbeiten, benötigen deshalb spezielle Prozessoren, die diese Aufgaben so effektiv wie möglich durchführen können.

Unsere Jacinto-Prozessoren vereinen dedizierte Signalverarbeitungsfunktionen (DSP) mit Matrixmultiplikationskernen, die mit dem industrieweit geringstem Stromverbrauch arbeiten – und das selbst bei Temperaturen bis zu 125 Grad Celsius.

„Es entstehen enorme Vorteile, wenn DSP und Prozessor in einem einzigen System auf einem Chip integriert werden,” sagte Curt. „Sonst bräuchte jedes Teil seinen eigenen Speicher und seine eigene Stromversorgung, was wiederum die Systemkosten in die Höhe treiben würde. Der andere Vorteil ist, dass durch die Integration dieser Funktionen auf einem Chip Latenzzeiten reduziert werden können.”

Zusätzlich zu energiesparenden Prozessoren besitzen unsere für Fahrzeuganwendungen qualifizierten integrierten Power-Management-Schaltungen Funktionen zur Unterstützung von funktionaler Sicherheit in Sensorfusion, Frontkameras und Domain Controllern, die die Energieeffizienz und Funktionstüchtigkeit des Fahrzeugs verbessern.

Unser gesamtes Ökosystem an ADAS-Produkten wurde für nahtlose Kompatibilität entwickelt. So können Autohersteller aus einem umfangreichen Portfolio an Produkten die für sie am besten geeigneten Produkte je nach Skalierbarkeit und Kostenpunkt auswählen.

„Wir haben alle Teile für das ADAS-Puzzle mit Blick auf die verschiedenen Herausforderungen, entwickelt,” sagte Miro. „So wird das Systemdesign für unsere Kunden einfacher.”

1.) https://www.aaa.com/AAA/common/AAR/files/ADAS-Technology-Names-Research-Report.pdf